Le fichier robots.txt est l’une des premières choses que Googlebot lit quand il arrive sur votre domaine. Mal configuré, il peut bloquer l’indexation de pages entières sans que vous vous en rendiez compte. Bien utilisé, il optimise votre crawl budget et concentre l’exploration sur ce qui compte vraiment. Dans cet article, nous décryptons chaque directive, les cas d’usage concrets et les erreurs classiques à éviter absolument.

Robots.txt : rôle et fonctionnement réel

Le fichier robots.txt est un simple fichier texte placé à la racine de votre site (ex : https://www.votresite.fr/robots.txt). Il communique aux robots d’exploration — Googlebot, Bingbot, et des dizaines d’autres — quelles parties du site ils sont autorisés à parcourir. Attention : robots.txt contrôle le crawl, pas l’indexation. Une page bloquée dans robots.txt peut tout de même apparaître dans Google si d’autres sites y font des liens.

C’est une distinction fondamentale. Beaucoup de webmasters confondent « bloquer le crawl » et « désindexer ». Si vous voulez qu’une page n’apparaisse pas dans les SERPs, la bonne technique est la balise noindex dans la section <head> — pas robots.txt. Selon Google Search Central, les directives robots.txt sont des suggestions, pas des ordres absolus pour certains crawlers tiers.

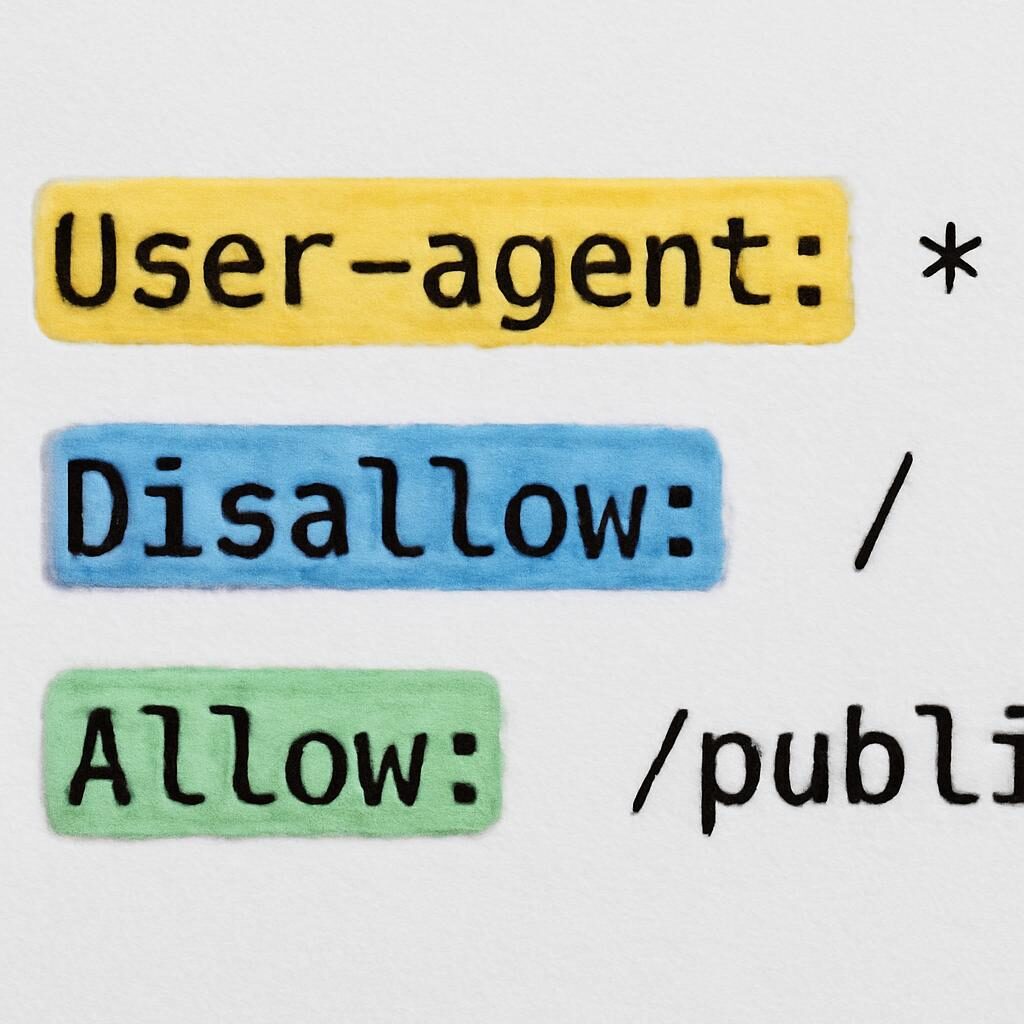

Directives User-agent, Disallow et Allow

La syntaxe de base se compose de trois éléments : User-agent identifie le robot ciblé (* pour tous), Disallow liste les chemins interdits, Allow crée des exceptions dans une règle Disallow. Un bloc vide Disallow: signifie « tout est autorisé ». Un bloc Disallow: / signifie « rien n’est accessible » — ce qui revient à bloquer complètement le crawl de votre site.

Dans la pratique, voici les directives les plus utilisées sur un site WordPress typique : bloquer /wp-admin/ (sauf /wp-admin/admin-ajax.php nécessaire aux plugins), bloquer /wp-login.php, et bloquer les paramètres d’URL inutiles (?s= pour la recherche interne, ?replytocom= pour les commentaires).

Construire son robots.txt : règles et exemples concrets

Un robots.txt efficace pour un site WordPress standard contient généralement entre 10 et 20 lignes. Nous recommandons de toujours commencer par déclarer votre sitemap XML — Google l’utilise pour croiser les URL à explorer. La ligne Sitemap: https://www.votresite.fr/sitemap_index.xml se place en fin de fichier, hors des blocs User-agent.

Ce qu’il ne faut jamais bloquer

Certaines ressources CSS et JavaScript sont indispensables pour que Googlebot puisse rendre vos pages. Depuis l’ère Mobile-First Indexing, Google doit voir vos pages exactement comme un utilisateur. Bloquer /wp-content/themes/ ou /wp-content/plugins/ peut nuire à votre score de rendu — ce que SEO technique met en évidence dans les audits Core Web Vitals. Ne bloquez jamais ces répertoires par défaut.

Une erreur fréquente consiste à bloquer les images dans robots.txt. Cela empêche Google Images de les référencer et peut priver vos articles d’une source de trafic complémentaire. Selon une étude BrightEdge (2024), Google Images représente encore 22 % du volume de recherche total aux États-Unis — un chiffre comparable en France sur certaines niches visuelles.

Robots.txt et crawl budget : un lien direct

Pour les sites de plus de 1 000 pages, robots.txt devient un levier de crawl budget direct. En bloquant les pages à faible valeur (pagination profonde, filtres de facettes e-commerce, pages d’archive dupliquées), vous concentrez l’enveloppe de crawl de Googlebot sur vos URL prioritaires. Des tests menés sur des sites e-commerce de taille moyenne ont montré des gains de fréquence de recrawl de 15 à 30 % après nettoyage du robots.txt.

Robots.txt vs balise meta robots : quand utiliser quoi

La balise <meta name="robots" content="noindex"> et robots.txt ne font pas la même chose. Robots.txt empêche le crawl (le robot ne lit pas la page). Meta robots empêche l’indexation (le robot lit la page, mais ne la met pas dans l’index). Ce que Google préconise : pour les pages sensibles ou dupliquées, utilisez noindex dans le HTML. Pour les ressources purement techniques (scripts, APIs internes), utilisez robots.txt. Ne combinez jamais les deux sur la même URL — Googlebot ne pourra pas lire le noindex si la page est bloquée dans robots.txt.

La balise X-Robots-Tag dans les en-têtes HTTP est une troisième option, particulièrement utile pour les PDFs et fichiers non-HTML que vous voulez exclure de l’index. Cette technique est sous-utilisée mais recommandée par Google Search Central pour les ressources non-web.

Tester et valider son fichier robots.txt

Google Search Console intègre un testeur de robots.txt directement dans l’outil d’inspection d’URL (anciennement l’outil dédié a été déprécié en 2022, mais la fonctionnalité reste accessible). Entrez n’importe quelle URL de votre site pour savoir si Googlebot est autorisé à la parcourir et quelle règle s’applique. Nous recommandons de tester systématiquement après chaque modification du fichier — une virgule mal placée ou un slash oublié peut avoir des conséquences dramatiques.

Screaming Frog peut également simuler le comportement de n’importe quel User-agent défini dans votre robots.txt. C’est particulièrement utile quand vous gérez plusieurs règles pour différents bots (Googlebot, Bingbot, crawlers d’outils SEO). Un SEO technique complet inclut toujours une vérification de la cohérence entre robots.txt, sitemap XML et directives noindex.

Questions fréquentes

Robots.txt empêche-t-il l’indexation d’une page ?

Non. Robots.txt bloque le crawl — Googlebot ne visite pas la page — mais ne garantit pas qu’elle reste hors de l’index. Si d’autres sites font des liens vers cette URL, Google peut l’indexer sans l’avoir explorée directement. Pour interdire l’indexation, utilisez la balise noindex dans le HTML de la page concernée.

Que se passe-t-il si robots.txt bloque Googlebot par erreur ?

Google Search Console signalera rapidement une chute de l’exploration dans le rapport de couverture. Les pages bloquées n’apparaissent plus dans les SERPs au bout de quelques semaines. Dès détection, corrigez robots.txt et demandez une resoumission via GSC. Le retour à la normale prend généralement 1 à 4 semaines selon la fréquence de crawl du site.

Comment ajouter son sitemap dans robots.txt ?

Ajoutez simplement la ligne Sitemap: https://www.votresite.fr/sitemap_index.xml en fin de fichier, après tous les blocs User-agent. Cette déclaration est universelle — elle s’applique à tous les bots, pas seulement à Googlebot. Yoast SEO génère automatiquement le sitemap et peut aussi l’ajouter au robots.txt si cette option est activée dans les réglages.

Robots.txt : un fichier simple, des enjeux complexes

Derrière sa syntaxe minimaliste, robots.txt est l’un des leviers les plus puissants et les plus risqués du SEO technique. Une configuration soigneuse permet de guider Googlebot vers vos contenus prioritaires, d’économiser votre enveloppe de crawl et d’éviter les duplicatas d’exploration. Consultez régulièrement votre rapport GSC et testez chaque modification avant de la déployer. Pour aller plus loin, découvrez comment le Google Core Update affecte le rôle du crawl dans la visibilité globale de votre domaine.

Pour aller plus loin

Le SEO forme un écosystème où technique, contenu, netlinking et SEA dialoguent en permanence. Pour prolonger cette analyse, nous recommandons :

- notre dossier sitemap XML SEO — robots.txt et sitemap XML forment le duo de pilotage du crawl.

- notre guide Core Web Vitals — le robots.txt influe directement sur le crawl et donc sur la prise en compte des CWV.

- notre guide des balises HTML SEO — meta robots et robots.txt se complètent pour piloter finement l’indexation.

- notre comparatif suivi de positionnement SEO — pour vérifier qu’aucune URL clé n’a été involontairement désindexée par robots.txt.

- notre dossier profil de liens naturel — un blocage robots.txt peut neutraliser le jus de lien d’un profil pourtant solide.

- notre guide des liens nofollow, dofollow, sponsored et ugc — robots.txt et attributs rel forment le duo de pilotage du signal de lien.